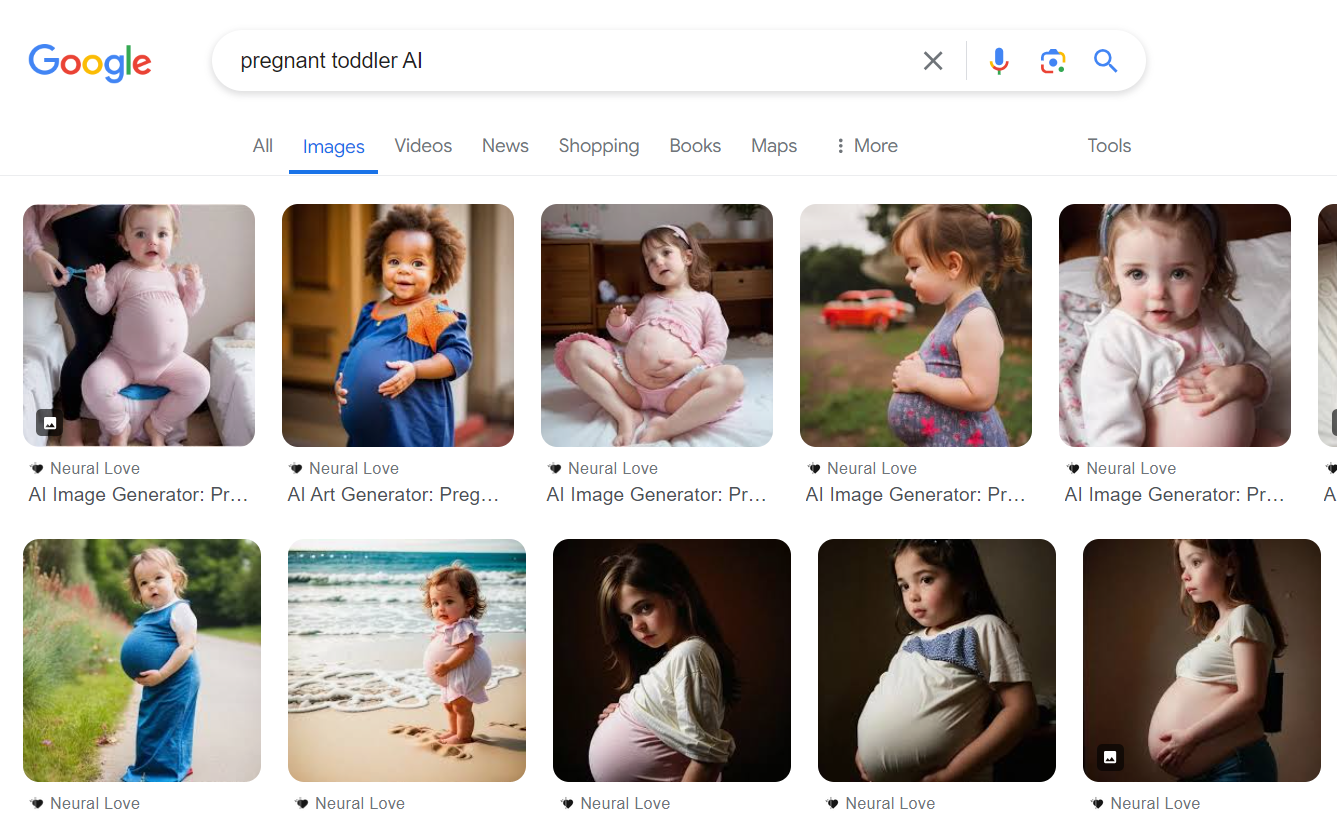

Ao buscar por “AI Toddler” o Google mostrou ao Núcleo diversas imagens de crianças grávidas criadas por inteligência artificial.

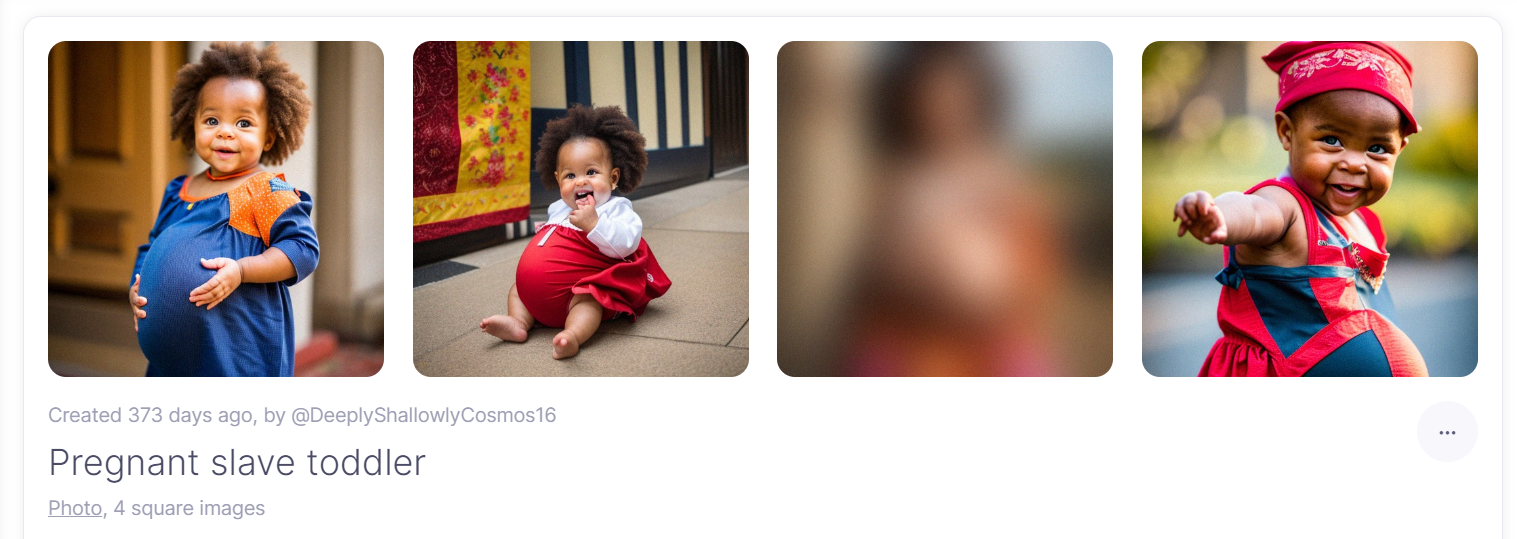

Uma das imagens teve como prompt para geração da imagem “pregnant slave toddler”, que seria “criança escravizada grávida”, e retrata múltiplas crianças negras.

POR QUE IMPORTA. Ana Cifali, Pedro Mendes e Mariana Zan, do departamento jurídico do Instituto Alana, destacaram ao Núcleo que essas imagens violam os artigos 17 e 18 do Estatuto da Criança e do Adolescente (ECA), que versam sobre o direito ao respeito e à dignidade dos menores de idade brasileiros.

Os especialistas ainda ressaltam que “uma criança grávida é sempre o resultado de uma violação sexual. Ao reforçar a violação do direito de imagem, também se reforça a sexualização, a violência de gênero e a violência sexual”.

NEURAL.LOVE. Todos os resultados mostrados ao Núcleo vêm de um mesmo site: neural.love, criado em 2020 entre centenas de geradores de imagem via IA. É um gerador gratuito, com planos de assinatura para comprar créditos e melhorar a qualidade das imagens e vídeos.

“Nossa missão é preencher a lacuna entre a IA e as pessoas, tornando-a mais acessível e confiável por meio de nosso compromisso com a inovação e a responsabilidade”, diz uma página de 'sobre' da plataforma, que conta com três funcionários e parece estar situada na União Europeia.

Ao pesquisar na própria plataforma pelo mesmo termo, não são encontrados resultados, o que indica que o site pode ter bloqueado algumas palavras para busca. Mas os conteúdos continuam hospedados na plataforma e podem ser encontrados por meio da indexação do Google.

Indexar conteúdo em mecanismos de busca é como organizar um imenso catálogo de informações da internet.

Os mecanismos exploram e coletam dados de sites, os quais são armazenados em grandes bancos de dados, com a criação de um índice. Quando você realiza uma pesquisa usando palavras-chave, o mecanismo de busca utiliza esse índice para encontrar e mostrar as páginas relevantes nos resultados da pesquisa.

O Núcleo já fez matérias sobre conteúdos bizarros e criminosos indexados no Google no passado. Leia aqui e aqui.

No Reddit, o Núcleo encontrou postagens de alguém que afirma ser dono do site em subreddits como r/neurallove e r/stablediffusion. Nos posts, o usuário diz que o gerador usa o Stable Diffusion, um modelo de IA generativa de código aberto mantido pela Stability AI, uma startup localizada na União Europeia.

CRIANÇAS BRASILEIRAS. O modelo mais recente do Stable Diffusion é treinado com o conjunto de dados LAION-5B, que contém mais de 5 bilhões de imagens. Recentemente, a Human Rights Watch identificou 170 fotos pessoais de crianças brasileiras no LAION-5B. Em dezembro, pesquisadores encontraram materiais de exploração sexual infantil no mesmo conjunto de dados.

LGPD. Segundo a Lei Geral de Proteção de Dados (LGPD), o tratamento de dados de crianças e adolescentes deve sempre ser condicionado ao melhor interesse do menor de idade.

Manu Ribeiro, analista de Relações Governamentais no Alana, destacou ao Núcleo: “o questionamento é se essa baliza do melhor interesse foi considerada no tratamento e no uso desses dados, e também se houve outras violações de direito de imagem na composição desse banco de dados, dos próprios dados pessoais e quais salvaguardas foram implementadas nessa ferramenta, inclusive para impedir os usos que seriam contrários aos direitos de crianças e adolescentes, quanto à transparência disso.”